NVIDIA Ampere A100 250-W-TDP-GPU auf PCIe 4.0 für KI, Data Science und Supercomputing mit vielversprechender 90-Prozent-Leistung des 400-W-Modells

NVIDIA hat die A100 offiziell vorgestellt, eine PCIe 4.0-kompatible GPU, die auf der Ampere-Architektur der nächsten Generation basiert. Obwohl NVIDIA ein niedrigeres 250-W-TDP-Profil aufweist, verspricht NVIDIA, dass die PCIe 4.0-Ampere-A100-GPU bis zu 90 Prozent der Leistung der vollen 400-W-A100-HGX-GPU bieten kann. Die A100 PCIe ist die dritte Variante der wachsenden Ampere A100-GPU-Familie und für Server gedacht, auf denen Cluster für künstliche Intelligenz (KI), Data Science und Supercomputing ausgeführt werden.

NVIDIA enthüllte eine PCI-Express 4.0-Variante der A100-GPU. Die GPU basiert auf der 7-nm-Ampere-Mikroarchitektur. Darüber hinaus kündigte das Unternehmen mehrere A100-Systeme führender Serverhersteller an, darunter Asus, Dell, Cisco, Lenovo und andere. Der 250-W-A100-PCIe-4.0-GPU-Beschleuniger ist der vollständigen 400-W-TDP-Variante ziemlich ähnlich, und NVIDIA verspricht trotz des deutlichen Rückgangs des TDP-Profils nahezu identische Leistung.

NVIDIA A100 Ampere-GPU in PCIe 4.0-Formfaktor mit derselben 400 W A100 HGX-GPU-Konfiguration, jedoch bei 250 W:

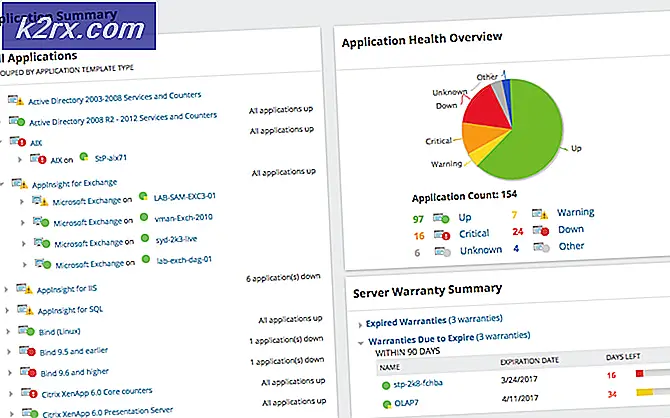

NVIDIA hat seinen PCIe 4.0 A100 PCIe GPU-Beschleuniger angekündigt. Die Ampere-GPU ist für eine Vielzahl von industriellen Anwendungsfällen mit Systemen verfügbar, die von einer einzelnen A100-PCIe-GPU bis zu Servern mit zwei Karten gleichzeitig über die 12 NVLINK-Kanäle reichen, die insgesamt 600 GB / s Verbindungsbandbreite liefern. Der 250-W-TDP-A100-PCIe-GPU-Beschleuniger ändert sich in Bezug auf die Kernkonfiguration im Vergleich zur 400-W-A100-HGX-GPU nicht wesentlich.

https://twitter.com/storagereview/status/1275132949709688833

Die GA100-GPU verfügt über die Spezifikationen der 400-W-A100-HGX-Variante mit 6912 CUDA-Kernen, die in 108 SM-Einheiten, 432 Tensorkernen und 40 GB HBM2-Speicher angeordnet sind und dieselbe Speicherbandbreite von 1,55 TB / s liefern (abgerundet auf 1,6 TB / s) s). Bereitstellen des GPU-Pakets auf dem PCIe 4.0-Standard hatte seinen eigenen Nachteil, die TDP signifikant zu reduzieren. Dies bedeutet angeblich eine Leistungsstrafe von 10 bis 50 Prozent, basierend auf der Arbeitsbelastung. Darüber hinaus eignet sich die 250-W-TDP-Variante der A100-GPU eher für kurze Bursts als für Dauerlasten.

NVIDIA A100 Ampere GPU In PCIe 4.0 Formfaktor Leistung:

Aufgrund der signifikanten Reduzierung des TDP-Profils konnte davon ausgegangen werden, dass die Karte niedrigere Takte aufweist, um den geringeren TDP-Eingang auszugleichen. Die von NVIDIA veröffentlichten Leistungsmetriken sind jedoch wirklich überraschend, da sie der 400-W-TDP-Variante ziemlich nahe kommen. Die FP64-Leistung wird weiterhin mit 9,7 / 19,5 TFLOPs bewertet, die FP32-Leistung wird mit 19,5 / 156/312 TFLOPs (Sparsity) bewertet, die FP16-Leistung wird mit 312/624 TFLOPs (Sparsity) bewertet und INT8 wird mit 624/1248 TOPs bewertet ( Sparsity).

Einfache Berechnungen zeigen, und NVIDIA versichert, dass die Ampere-basierte PCIe 4.0 250W A100-GPU 90 Prozent der Leistung der A100 HGX-Karte (400W) in Top-Serveranwendungen liefern kann. Dies ist gerechtfertigt, da die neue Variante weniger Zeit benötigt, um die oben genannten Aufgaben zu erledigen. Die Zahlen sollten jedoch nur für kurze Intervalle gültig sein. In komplexen Situationen, in denen dauerhafte GPU-Funktionen erforderlich sind, kann die 250-W-PCIe-4.0-GPU eine Leistung von bis zu 90 Prozent bis zu 50 Prozent der Leistung der 400-W-A100-HGX-GPU liefern.

Die Ampere-Mikroarchitektur wird sicherlich dem neuen A100 zugute kommen. NVIDIA verspricht eine mindestens 20-fache Leistungssteigerung gegenüber dem Volta-basierten Vorgänger. Die PCIe 4.0 A100-GPU verfügt über eine GPU-Technologie mit mehreren Instanzen. Dies bedeutet, dass ein einzelner A100 in bis zu sieben separate GPUs aufgeteilt werden kann, um verschiedene Computeraufgaben zu erledigen. Während dies die Segmentierung fördert, gibt es NVLink der 3. Generation, mit dem mehrere GPUs zu einer riesigen GPU verbunden werden können.